لاحظ Vhey Preexa ، فنان الذكاء الاصطناعي الذي يستخدم اسم “Zovya” على الإنترنت ، نمطًا أثناء محاولته إنشاء أداة تعمل بالذكاء الاصطناعي تنتج صورًا رقمية لشعب وثقافة أمريكا الجنوبية.

قال بريكسا إنه في العديد من الصور الناتجة عن أمريكا الجنوبية ، والتي تم إجراؤها باستخدام نموذج التعلم العميق من مولد الفن AI-Art مفتوح المصدر ، Stable Diffusion ، ستظهر الوجوه الآسيوية والعمارة الآسيوية بشكل عشوائي.

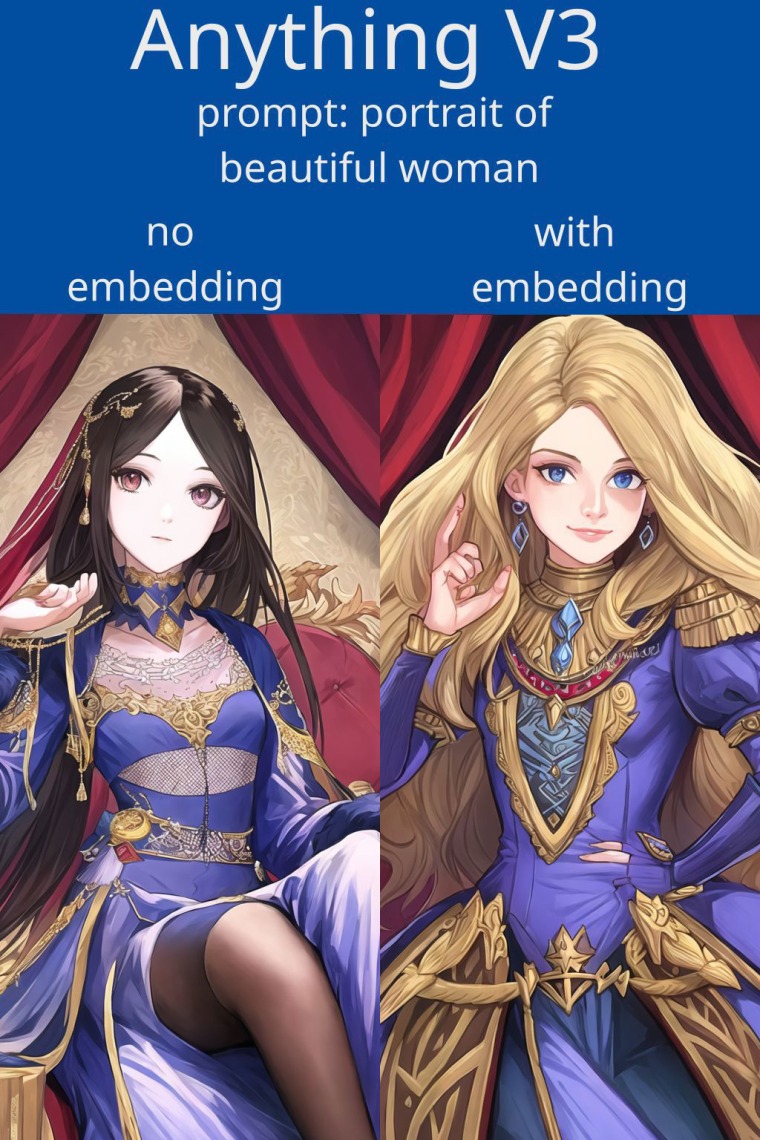

لتعويض ما اعتبرته استخدامًا مفرطًا للسمات والثقافة الآسيوية في نماذج الذكاء الاصطناعي ، طورت Preexa ، وهي صربية تعيش في الولايات المتحدة ، أداة جديدة ، “Style Asian Less” ، للتخلص من التأثير غير المقيد للرسوم المتحركة الآسيوية واليابانية في الصور التي تم إنشاؤها.

“Style Asian Less” هو وحدة مضمنة في Civitai ، وهو مجتمع فني للذكاء الاصطناعي حيث يمكن للأشخاص تحميل ومشاركة النماذج التي تخلق صورًا واقعية من أوصاف النص. تم تنزيل الأداة أكثر من 7000 مرة في الشهرين الماضيين على Civitai.

قال بريكسا: “لم يتم تصميم الأداة لمبادلة السباق كما قد يعتقد البعض في البداية” ، موضحًا أنها ببساطة توازن بين الجمالية الآسيوية القوية في بيانات التدريب لنماذج الفن الحديث.

قالت ساشا لوتشيوني ، باحثة أخلاقيات الذكاء الاصطناعي ومقرها مونتريال في Hugging Face ، وهي شركة ناشئة للذكاء الاصطناعي ومقرها مدينة نيويورك ، إن مولدات تحويل النص إلى صورة تميل إلى تعزيز التحيزات المجتمعية القائمة.

وقالت: “الطريقة التي يتم بها تدريب نماذج الذكاء الاصطناعي هي أنها تميل إلى تضخيم الطبقة المهيمنة” ، مشيرة إلى أن المجموعات الممثلة تمثيلا ناقصا ، سواء كانت عرقية أو اقتصادية ، “تميل إلى الغرق”.

ووجدت أن فن الذكاء الاصطناعي يتأثر بشكل مفرط بالسمات الآسيوية التي أدخلها عدد كبير من الهواة في الدول الآسيوية في مجموعات البيانات. لذلك قد تزيد الصور الآسيوية في الفهرسة في الحالات التي يبحث فيها شخص ما ، على سبيل المثال ، أمريكا الجنوبية ، عن صور تمثيلية لأشخاص من بلدهم.

“تحتوي جميع نماذج الذكاء الاصطناعي على تحيزات متأصلة تمثل مجموعات البيانات التي تم تدريبهم عليها. قال موتيز بشارة ، المتحدث باسم منظمة Stability AI: “من خلال المصادر المفتوحة لنماذجنا ، فإننا نهدف إلى دعم مجتمع الذكاء الاصطناعي والتعاون لتحسين تقنيات تقييم التحيز وتطوير حلول تتجاوز التعديل الأساسي السريع”.

قال Luccioni إنه في حين أنه من الصعب جمع بيانات ديموغرافية دقيقة عن فناني الذكاء الاصطناعي ، فإنه يتتبع الاهتمام المتزايد من آسيا بإدخال تحيزات جديدة في النماذج.

وقالت: “يمكنك ضبط نموذج الانتشار المستقر على بيانات من اليابان ، وسوف تتعلم هذه الأنماط وتكتسب الصور النمطية الثقافية لهذا البلد”.

من جانبها ، قالت بريكسا إنها لم تجد تشبع الصور الآسيوية في النماذج الفنية للذكاء الاصطناعي مشكلة.

قالت: “الأداة التي صنعتها هي مجرد واحدة من أدوات عديدة لمساعدة المستخدم في الحصول على الصورة التي يريدها”.

قالت كيسي فيسلر ، الأستاذة المشاركة في جامعة كولورادو بولدر والمتخصصة في أخلاقيات الذكاء الاصطناعي ، إنها لاحظت وجود جمالية آسيوية قوية في العديد من الصور التي أنتجها المولّدون الفنيون.

قالت: “يبدو أن الكثير من هذه العارضات قد تم تدريبهن على الأنمي”. “إن مسألة التمثيل وما تحتويه بيانات التدريب أمر مثير للاهتمام حقًا. هذا نوع جديد من التجاعيد فيه “.

قال فيزلر إن هدف أداة “الأسلوب الأقل آسيوية” المتمثل في التخلص من التحيز المفترض لنماذج الذكاء الاصطناعي هذه تجاه السمات الآسيوية ، يذكرنا باستراتيجية التخفيف من التحيز من مبادرات الذكاء الاصطناعي الأخرى ، مثل محاولة عكس تنوع عامة السكان بشكل أكثر دقة. . من الأمثلة على ذلك جعل الصور للبحث عن “CEO” أكثر تنوعًا. انتقد بعض المستخدمين مثل هذه الإجراءات لتشويه الواقع ، مع ذلك ، مشيرين إلى أن الرؤساء التنفيذيين هم رجال بيض بشكل غير متناسب.

مع ازدياد شعبية مولدات الفن بالذكاء الاصطناعي على مدار العام الماضي ، زاد قلق بعض الباحثين والدعاة من ميلهم إلى تعزيز الصور النمطية الضارة ضد النساء والأشخاص الملونين.

بالنسبة للصور الآسيوية على وجه التحديد ، قال Luccioni إن هناك تمثيلًا زائدًا للصور الآسيوية مفرطة الجنسية في مجموعات البيانات التي تدرب نماذج الذكاء الاصطناعي.

قالت: “هناك الكثير من مواقع الأنمي والهنتاي”. “على وجه التحديد حول النساء والنساء الآسيويات ، هناك الكثير من المحتوى الذي يعارضهن.”

عندما أصدر تطبيق AI Lensa ميزة “Magic Avatars” الفيروسية العام الماضي ، والتي أنتجت صورًا حالمة لأشخاص استنادًا إلى صورهم الذاتية ، قالت العديد من النساء الآسيويات إن التشابه الذي تلقينه كان “إباحيًا” بشكل علني وعرضه فقط ميزات شرق آسيا.

قالت فيسلر إنه بينما تتعارض مع إمكانية نموذج “أسلوب أقل آسيوية” لإدخال قوالب نمطية جديدة عن طريق تصفية الخصائص المرتبطة بمجموعة عرقية معينة ، يمكن أن تكون أداة مفيدة لمعالجة التحيزات في بيانات التدريب.

قالت: “لكن من المهم أن نفهم أن الذكاء الاصطناعي لا يعكس الواقع”. “إنها تعكس حقًا بيانات التدريب الخاصة بهم ، والتي تعكس ما هو موجود على الإنترنت.”

اكتشاف المزيد من ينبوع المعرفة

اشترك للحصول على أحدث التدوينات المرسلة إلى بريدك الإلكتروني.